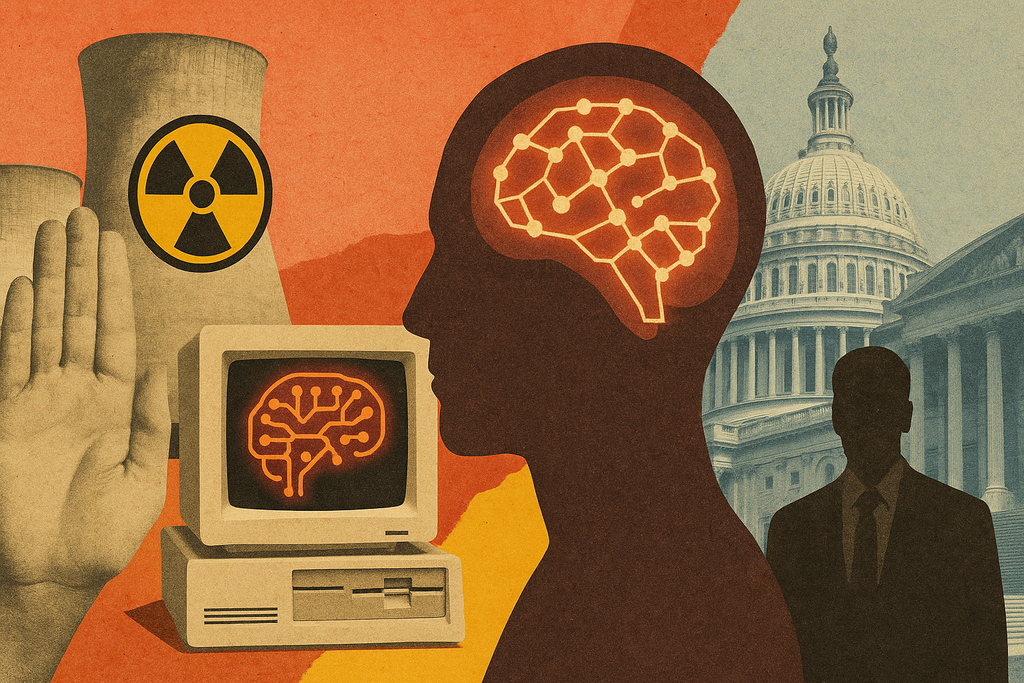

La inteligencia artificial (IA) presenta un potencial transformador, pero también conlleva riesgos significativos, como su posible uso indebido en la proliferación nuclear. Para abordar esta amenaza, Anthropic y la Administración Nacional de Seguridad Nuclear de EE.UU. (NNSA) han desarrollado un clasificador antinuclear. Este sistema, similar a los filtros de spam, distingue entre conversaciones benignas sobre energía nuclear y aquellas que buscan información sensible sobre armamento.

El proyecto implicó un año de pruebas con el modelo de lenguaje Claude, utilizando escenarios hipotéticos para identificar patrones de riesgo. Los resultados fueron prometedores, alcanzando una precisión superior al 96%, detectando casi el 95% de consultas peligrosas sin producir falsos positivos. Sin embargo, el sistema no es infalible y un 5,2% de conversaciones dañinas fueron etiquetadas erróneamente como benignas.

Ya implementado de forma experimental, el clasificador enfrenta desafíos en el mundo real, como la identificación errónea de discusiones legítimas durante tensiones geopolíticas. Para corregir esto, se utiliza un sistema de resúmenes jerárquicos que revisa conversaciones en conjunto para discernir su contexto.

Este avance plantea la cuestión de si las medidas de mitigación pueden evolucionar al ritmo del desarrollo tecnológico, dado que los modelos de lenguaje se vuelven cada vez más potentes. Anthropic planea compartir su investigación con otras grandes compañías de IA, buscando establecer un estándar en el sector para mitigar estos riesgos.